En cierto momento de la historia, los problemas de sincronización fueron un verdadero inconveniente. Pero gracias al G-Sync de Nvidia por fin lo estamos dejando atrás, incluso aunque este proceso sea algo lento. Aunque por otro lado, el uso del G-Sync también incluye sus propios problemas. Entonces, ¿Realmente vale la pena el esfuerzo? Vamos a averiguarlo.

En primer lugar analizaremos el eje de toda la cuestión – el tearing de pantalla.

Tearing de Pantalla

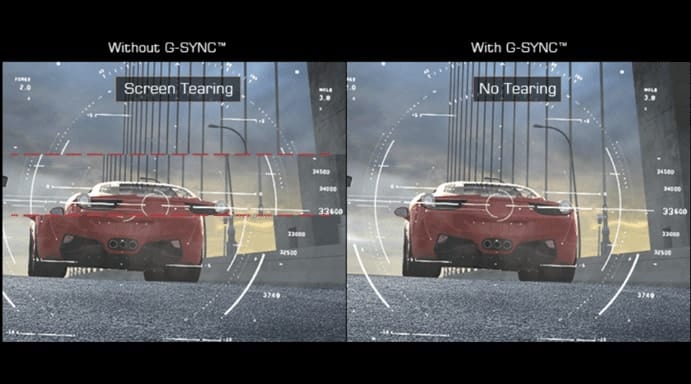

Ejemplo de tearing de pantalla

Esta cuestión surgió en algún momento a finales de la década del 2000 y alcanzó su punto de quiebre durante los primeros años de la década del 2010, cuando todos el mundo empezó a buscar la mejor solución posible para este problema. Si antes no hubo indicios del tearing de pantalla, fue porque tanto las tarjetas gráficas como los dispositivos de pantalla estaban optimizados y sincronizados perfectamente para brindar el mejor rendimiento posible.

Sin embargo, a medida que los gráficos de los videojuegos comenzaron a volverse más y más realistas, los fabricantes de las GPU también quisieron que sus tarjetas siguieran siendo la mejor herramienta para renderizar este tipo de imágenes.

Un juego como Crysis es el mejor ejemplo de esto. Cuando salió en un primer momento, fue toda una maravilla tecnológica, y realmente no había muchas PC capaces de ejecutarlo en sus niveles máximos de resolución y de detalles, a pesar de incluir componentes de hardware de alta gama

Los elevados requisitos de hardware incluso se convirtieron en meme dentro de las comunidades de gamers, y fueron un gran incentivo para que los fabricantes diseñaran nuevas GPU con incrementos de rendimiento cada vez más elevados.

Por otro lado, este proceso terminó dejando bastante atrás a los monitores en cuanto al rendimiento, y llevó algo de tiempo que logren alcanzarlo. Y mientras tanto, las GPU siguieron potenciándose de forma exponencial, al punto de llegar a generar valores de fotogramas realmente ridículos.

Cuando lograron entregar más de 100 fotogramas por segundo, las tarjetas gráficas le hicieron morder el polvo a los monitores con frecuencias de actualización de 60Hz. Entonces, el lado negativo de la mejora de las GPU fue la incapacidad de los monitores para mostrar esos fotogramas adicionales, lo que ocasionó problemas como el stuttering y el tearing de pantalla.

El tearing de pantalla impactará de forma negativa en tu experiencia gaming

El tearing de pantalla ocurre cuando el monitor intenta mostrar más de un fotograma en la pantalla al mismo tiempo, y es la consecuencia de que la tarjeta gráfica produzca y envíe al monitor fotogramas adicionales.

Esto es realmente muy molesto y rompe por completo la experiencia inmersiva: Pero afortunadamente Nvidia resolvió este problema con una solución genial.

¿Qué es el G-Sync?

El Predecesor – El VSync

Antes del lanzamiento del G-Sync, la solución transitoria para el tearing de pantalla fue el VSync. Y aunque distaba de ser la solución ideal, pudo cumplir con su propósito y ayudó mucho para el avance de otras tecnologías como el G-Sync y el FreeSync.

El VSync evitaría que la GPU emitiera más fotogramas de los que el monitor fuese capaz de administrar. Por ejemplo, si la frecuencia del monitor era de 60Hz, VSync limitaría la emisión de fotogramas a un máximo de 60FPS.

Sin embargo, esta no sería una solución completa, pues no existía la opción de sincronizar los FPS con la frecuencia de actualización del monitor, en caso de que la GPU no fuera capaz de generar los fotogramas suficientes como para igualar la frecuencia de la pantalla.

Introducción al G-Sync

Esta revolucionaria tecnología de Nvidia fue lanzada en el año 2013, y sobrevivió sin problemas al paso de los años (y probablemente lo siga haciendo por un largo rato). Gracias al G-Sync, el tearing de pantalla aparentemente es cosa del pasado, es decir que no tendremos que preocuparnos más por él durante los próximos años, y seguramente siga el mismo camino que los discos flexibles – será olvidado.

Nvidia básicamente tomó prestada la idea del VSync, en términos de limitar las FPS, pero a su vez la hizo propia y la expandió.

La razón detrás de su tremendo éxito es que también lanzaron un módulo para monitores, que es lo que le comercializan a los fabricantes anexando la certificación G-Sync. Esto es necesario porque el módulo es quién se comunica con la GPU y obtiene la información de los fotogramas que están siendo generados, para ajustar sobre la marcha la frecuencia de actualización del monitor, de manera que ambos coincidan.

También se encarga de trasmitir a la tarjeta gráfica la cantidad máxima de fotogramas que el monitor puede desplegar, de modo que la GPU no genere fotogramas adicionales. Si esto suena demasiado genial, es porque realmente lo es.

El G-Sync genera un mundo de diferencias

Entonces, G-Sync es la solución perfecta para el tearing de pantalla. Pero (y desafortunadamente siempre hay un ´pero´), este ajuste perfecto va de la mano con un incremento del precio.

Como indicamos anteriormente, Nvidia le exige a los fabricantes una certificación G-Sync para verificar que esta tecnología funcionará en sus monitores: que como te imaginarás, no es gratuita. Y para compensar esta certificación G-Sync, los fabricantes deben incrementar el precio de sus monitores.

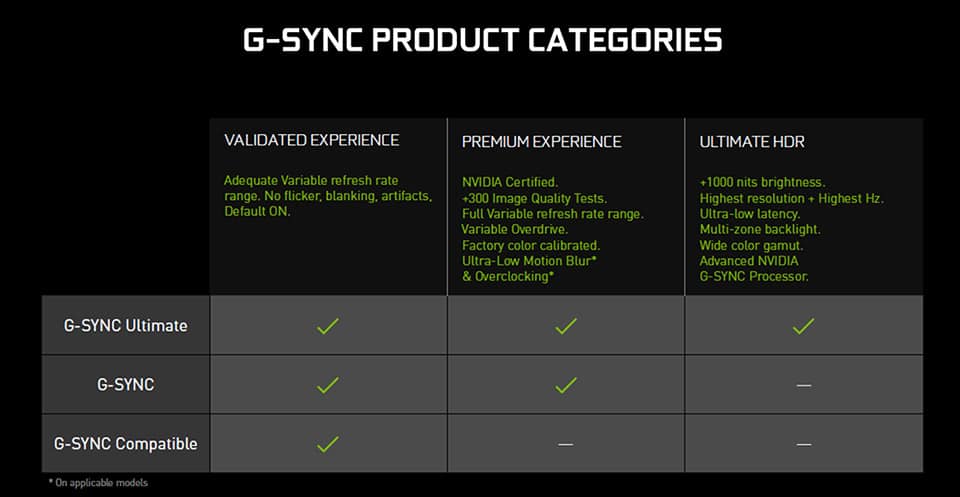

G-Sync Ultimate

Como una opción adicional al G-Sync, la versión Ultimate trae un incremento mayor en los precios, pero también muchas características geniales.

Y probablemente lo mejor del G-Sync Ultimate sea que Nvidia se las arregló para introducir 1152 zonas de retroiluminación. Y el hecho de que haya tanta cantidad de estas zonas significa que el panel IPS producirá imágenes HDR (high dinamic range – alta gama dinámica) con una mayor precisión.

Otra cosa que hace descollar al G-Sync Ultimate son sus impresionantes 1400 nits, que permiten que estas imágenes HDR sean realmente nítidas y renderizadas con una mejor iluminación.

G-Sync Compatible

Este es un método de G-Sync alternativo. A pesar de promocionar todo el concepto como una exclusividad de Nvidia, la compatibilidad con G-Sync permitió modificar los estándares de certificación. Gracias a esto, otros monitores con frecuencia de actualización variable (VRR) o que incluso estén certificados con FreeSync, pueden ejecutar G-Sync.

Y si bien es cierto que hay muy pocos monitores certificados para ser compatibles con G-Sync, no hay dudas de que este es un paso en la dirección correcta.

¿Vale la Pena el G-Sync de Nvidia?

Esta tabla muestra las diferencias entre pantallas normales G-Sync, G-Sync Ultimate y G-Sync Compatible. Créditos de la imagen: Nvidia

Aunque un filósofo bien podría argumentar que el valor depende de la experiencia individual, en el mundo de la tecnología las cosas son algo diferentes. Porque contamos con números claros y concisos para establecer, por medio de los hechos, si determinada tecnología vale el costo a pagar o no.

Sin embargo, como los valores aquí se miden en milisegundos, al ojo inexperto le podría costar bastante llegar a notar las diferencias. Pero sí podemos hacer una buena comparación entre el G-Sync de Nvidia y el FreeSync de AMD.

Lo que debes saber es que cada tecnología constituye la solución de las respectivas compañías para el tearing de pantalla, y que ambas requieren de una certificación del monitor para maximizar el placer de disfrutar plenamente de las tarjetas.

Pero la diferencia entre ambas tecnologías es que AMD no requiere el pago de una certificación FreeSync de parte de los fabricantes, y por lo tanto no hay costos adicionales. Es decir que adquirir un monitor certificado para FreeSync es mucho más económico.

FreeSync es la solución ideal para las tarjetas gráficas de AMD

Finalmente, todo este hilo argumental debe concluir en la cuestión del rendimiento. Y en este apartado Nvidia logra superar a AMD en casi todas las categorías, de modo que, si estás buscando una jugabilidad extremadamente fluida y muy detallada, entonces G-Sync de Nvidia debe ser tu elección.

Aunque claro, si puedes conformarte con una frecuencia de fotogramas estable sacrificando algunos detalles a cambio de la experiencia, y sobre todo si tienes un presupuesto ajustado, optar por el FreeSync de AMD debería ser una elección bastante lógica.

Deja una respuesta